دیپ فیک و از بین رفتن مرز دروغ و واقعیت

- توسط : محبوبه خاوری

- در : ۱۳۹۹-۰۳-۲۱

- در : اخبار تکنولوژِی دانستنیها

از بین تمام قدرتهای ترسناک اینترنت، توانایی فریب دادن افراد ناشناس ممکن است وحشتناک ترین باشد و خبر بد این که این امکان وجود دارد و خبر خوب این که این امکان وجود دارد.

Clickbait ها و روش های طعمه برای کلیک، تصاویر فتوشاپ و خبرهای دروغین از بدترین و البته جالب ترین موضوعات اینترنت هستند اما سال های اخیر شاهد ظهور ابزار جدیدی که به نظر فوق العاده جالب و البته خطرناک است بوده که به آن هوش مصنوعی عمیق یا (AI) می گویند. یکی از این ابزارهایی که بر اساس هوش مصنوعی عمیق کار می کند تکنولوژی جالبی است که به آن دیپ فیک می گویند. در ادامه می خواهیم به آشنایی با فناوری دیپ فیک بپردازیم.

اصطلاح دیپ فیک Deepfake در زبان اهل فن به معنای فیلم و صوت تقلبی است که به کمک رایانه ساخته می شود که تشخیص جعلی بودن آن بسیار (بسیار) سخت است.

نمونه هایی از دیپ فیک

GAN یا شبکه های مولد متخاصم که به عنوان یکی از زیر شاخه های یادگیری عمق شناخته می شود قادر است مجموعه ای از تصاویر را به صورت عمیق در خود ثبت کند و تصاویر کاملاً مشابه با تصاویر اولیه که با آن مو نمی زنند را شبیه سازی کند. GAN ها استفاده های زیادی دارند و تنها با نیات خرابکارانه و جعل کردن استفاده نمی شوند اما باید قبول کرد که استفاده از آن ها برای جعل واقعاً نتایج عالی ای داشته است! برای مثال در سال ۲۰۱۸، یک نقاشی GAN ساخته شد که به تقلید از سبک نقاش بزرگ هلندی قرن هفدهمی رامبراند ایجاد شده بود و در خانه حراج کریستی به قیمت ۴۳۲٫۵۰۰ دلار باورنکردنی فروخته شد.

آشنایی با فناوری دیپ فیک

اما وقتی GAN ها روی پرونده های ویدیویی و صوتی کار می کنند می توانند خطرناک شوند و فیک سازی های نسبتاً بی نقصی را خلق کنند.

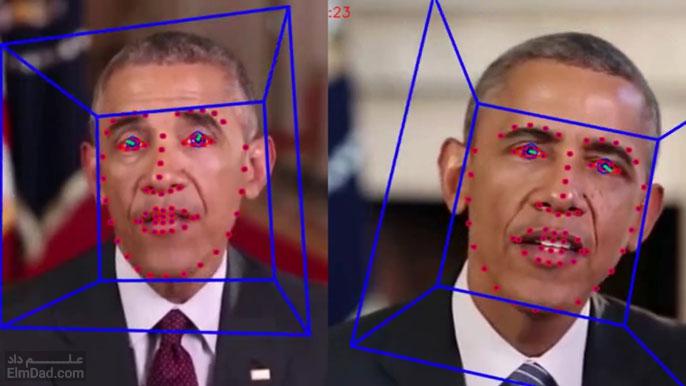

در سال ۲۰۱۷، محققان دانشگاه واشنگتن در سیاتل برای تغییر ویدیوی رئیس جمهور پیشین ایالات متحده یعنی باراک اوباما از هوش مصنوعی استفاده کردند و توانستند در یک ویدیو طوری حرکت لب های او را تغییر دهند و صدای او را دقیقاً با همان صوت و لحن تولید کنند که جمله ای را از زبان چهره شبیه سازی شده او دقیقاً با صدای اوباما و حرکات لب و حالت چهره او تولید نمایند.

از همان سال دسپ فسیک ها به شدت پیشرفت کرده اند واکنون از تکنیک های GAN اغلب جایگذاری و تولید چهره های افراد مشهور به صورت فیک و کپی شده استفاده می شود و تا به حال از چهره گال گادوت، میسی ویلیامز و تیلور سویفت روی بدن بازیگران فیلم های مستهجن استفاده شده است.

نوع دیگر از GAN ها نیز وارد دنیای دیپ فیک ها شده اند که می توانند تنها با داشتن یک عکس از تصویر یک فرد از آن تصاویر دیگری بسازند و یا فیلم هایی را بر اساس تولید نمایند. در سال ۲۰۱۹ بر همین اساس با کمک تصویر مونالیزا (لبخند ژوکوند) فیلمی از مونالیزا ساخته شد که در آن مونالیزا می توانست صحبت کند و یا حرکت نماید و لبخند بزند و فعالیت های مختلف دیگری را انجام دهد.

آشنایی با فناوری دیپ فیک

علاوه بر این دیپ فیک ها می توانند محتوا های صوتی را نیز تغییر دهند؛ این تکنیک می تواند کلمات جدیدی را در فیلم شخصی که در حال صحبت است جدا کند و طوری جملات شخص را تغییر دهد که روحش هم از آن بی خبر باشد.

همه این موضوعات در نگاه اول واقعاً جالب و سرگرم کننده اند اما در باطن امر تغییرات بالقوه ترسناکی را به همراه خواهند داشت. اکر شخصی در یک گوشه دنیا بتواند فیلم های واقع گرایانه ای را بسازد که در آن رئیس جمهور یا یک سیاستمدار در حال صحبت است و کلماتی را می گوید که در حقیقت هرگز نگفته است و عده زیادی از بینندگان آن ویدیو آن را باور کنند چه؟! آنگاه چه چیزی واقعیت است و چه چیزی دروغ و به چیز می توان اعتماد کرد و به چه چیز نمی توان اعتماد کرد؟!

دیدگاه ها

0 دیدگاه